Livre de commutation et de pontage RouterOS v7

Matériel d'étude pour le cours de certification MTCSWE mis à jour vers RouterOS v7

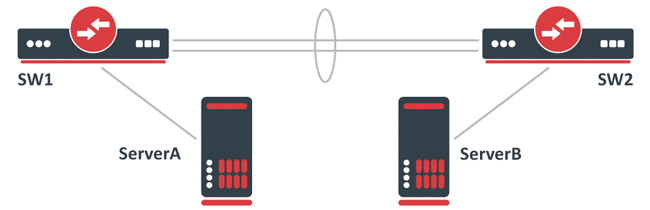

Étape: Une interface LAG (Link Aggregation Group) a été créée pour augmenter la bande passante totale entre deux nœuds du réseau, généralement des commutateurs.

Pour tester le bon fonctionnement de l'interface LAG, deux serveurs transférant les données ont été connectés, généralement à l'aide de l'outil de mesure des performances du réseau. Iperf.

A la fin de l'article vous trouverez un petit tester cela vous permettra évaluer les connaissances acquises dans cette lecture

Par exemple, une interface LAG peut avoir été créée à partir de deux ports Gigabit Ethernet, fournissant une interface virtuelle capable d'équilibrer le trafic entre les deux interfaces et d'atteindre théoriquement un débit de 2 Gbit/s.

Les serveurs, dans ce cas, sont connectés via une interface 10 Gbps, telle que SFP+.

/interface bonding

add mode=802.3ad name=bond1 slaves=ether1,ether2

/interface bridge

add name=bridge1

/interface bridge port

add bridge=bridge1 interface=bond1

add bridge=bridge1 interface=sfp-sfpplus1

Après les premiers tests, on constate que les performances du réseau ne dépassent jamais la limite de 1 Gbps, bien que la charge CPU sur les serveurs et les nœuds du réseau (switches) soit faible. En effet, LACP (802.3ad) utilise une politique de hachage de diffusion pour déterminer si le trafic peut être équilibré sur plusieurs membres du LAG.

Dans ce cas, une interface LAG ne crée pas une interface 2 Gbit/s, mais plutôt une interface capable d'équilibrer le trafic sur plusieurs interfaces esclaves lorsque cela est possible.

Pour chaque paquet, un hachage de transmission est généré, qui détermine par quel membre du LAG le paquet sera envoyé, évitant ainsi que les paquets ne soient dans le désordre.

Il existe la possibilité de sélectionner la politique de hachage de transmission, qui vous permet généralement de choisir entre la couche 2 (MAC), la couche 3 (IP) et la couche 4 (Port).

Sur RouterOS, cela peut être sélectionné à l'aide du paramètre transmission-hash-policy. Dans ce cas, le hachage de transmission est le même puisque les paquets sont envoyés à la même adresse MAC ainsi qu'à la même adresse IP et Iperf utilise également le même port, générant ainsi le même hachage de transmission pour tous les paquets et empêchant l'équilibrage de charge entre les membres du LAG. .

Il convient de noter que les paquets ne seront pas toujours équilibrés sur les membres du LAG même lorsque la destination est différente, puisque la politique de hachage de transmission standardisée peut générer le même hachage de transmission pour différentes destinations.

Sélectionnez la politique de hachage de transmission appropriée et testez correctement les performances du réseau.

Le moyen le plus simple de tester de telles configurations consiste à utiliser plusieurs cibles. Par exemple, au lieu d’envoyer des données à un seul serveur, les données doivent être envoyées à plusieurs serveurs.

Cela générera un hachage de transmission différent pour chaque paquet et rendra possible l’équilibrage de charge entre les membres du LAG.

Dans certains cas, vous pouvez envisager de modifier le mode de l'interface de liaison pour augmenter les performances globales.

Pour le trafic UDP, le mode balance-rr peut être suffisant, mais peut entraîner des problèmes pour le trafic TCP.

Vous pouvez en savoir plus sur la sélection du bon mode pour votre configuration ici !.

Le choix du mode de collage est crucial. Bien que balance-rr (round-robin) puisse être efficace pour le trafic UDP, il n'est peut-être pas idéal pour TCP en raison de la possibilité de réorganisation des paquets. Il est donc important de considérer le type de trafic qui prédominera dans le réseau lors du choix du mode de liaison.

D'autres aspects de la configuration du réseau peuvent également influencer les performances du LAG. Par exemple, la configuration du commutateur, les capacités matérielles et les politiques réseau peuvent affecter la manière dont le trafic est géré sur les interfaces LAG.

Il est essentiel de mettre en œuvre des outils de surveillance et de diagnostic pour mieux comprendre le comportement du trafic à travers le LAG. Des outils comme Wireshark ou même des fonctionnalités de diagnostic intégrées aux commutateurs peuvent fournir des informations précieuses.

Bien que l'interface LAG puisse théoriquement atteindre une bande passante de 2 Gbit/s dans ce scénario, il ne faut pas oublier que les performances réelles peuvent être affectées par plusieurs facteurs, tels que la qualité du câblage, la distance entre les appareils et la configuration matérielle elle-même.

Les tests avec différentes configurations et types de trafic peuvent aider à identifier la meilleure configuration pour un environnement spécifique. Cela peut inclure la variation de l'adresse IP de destination, du port ou même du type de trafic (TCP vs UDP).

S'assurer que les commutateurs et les serveurs exécutent la version la plus récente et la plus stable de leur micrologiciel et de leurs logiciels peut résoudre des problèmes jusqu'alors non identifiés et améliorer les performances globales.

L'équilibrage de charge sur une interface LAG est un processus complexe qui nécessite une configuration minutieuse et une compréhension détaillée du réseau et de ses composants.

Grâce à une sélection appropriée des politiques de hachage de transmission et à des tests approfondis, les performances du réseau peuvent être optimisées et garantir que les ressources disponibles sont utilisées efficacement.

De plus, se tenir au courant des mises à jour et des meilleures pratiques en matière de configuration réseau peut contribuer de manière significative à l’efficacité et à la stabilité de votre environnement réseau.

Matériel d'étude pour le cours de certification MTCSWE mis à jour vers RouterOS v7

Av. Juan T. Marengo et J. Orrantia

Bâtiment du Centre Professionnel, Bureau 507

Guayaquil. Équateur

CP 090505

à nos newsletters hebdomadaires

Copyright © 2024 abcxperts.com – Tous droits réservés

Profitez du code de réduction Three Kings Day !

Profitez du code de réduction du réveillon du Nouvel An !

Profitez du code de réduction pour Noël !!!

tous les cours MikroTik OnLine

tous les cours de l'Académie

tous les livres et packs de livres MikroTik

Profitez des codes de réduction pour la Cyber Week !!!

tous les cours MikroTik OnLine

tous les cours de l'Académie

tous les livres et packs de livres MikroTik

Profitez des codes de réduction pour le Black Friday !!!

**Les codes sont appliqués dans le panier

Profitez de codes de réduction pour Halloween.

Les codes sont appliqués dans le panier

11% de réduction sur tous les cours MikroTik OnLine

11%

30% de réduction sur tous les cours de l'Académie

30%

25 % de réduction sur tous les livres et packs de livres MikroTik

25%